Hadoop与Spark性能深度对比 在大数据生态中的选择与应用

在大数据处理领域,Hadoop与Spark作为两大核心框架,常常成为技术选型中的焦点。火龙果软件工程与果安奇云数据在构建高效数据库解决方案时,对两者的性能特点有着深入的理解和应用实践。本文将从多个维度对Hadoop与Spark进行性能对比分析,以期为相关技术决策提供参考。

一、架构与计算模型

Hadoop的核心是MapReduce计算模型和HDFS分布式文件系统。其设计思想是将计算任务分解为Map(映射)和Reduce(归约)两个阶段,通过磁盘I/O进行数据交换,适合处理超大规模、批处理型的数据任务。这种架构保证了极高的容错性和扩展性,但牺牲了部分迭代计算和实时处理的性能。

Spark则采用了基于内存的弹性分布式数据集(RDD)模型。它允许将中间结果缓存在内存中,减少了大量的磁盘I/O操作,特别适合需要多次迭代的机器学习算法、图计算和流式数据处理。Spark支持比MapReduce更丰富的操作类型,如transformations和actions,提供了更灵活的数据处理能力。

二、性能表现对比

- 数据处理速度:在迭代计算和交互式查询场景下,Spark凭借内存计算通常比Hadoop MapReduce快10到100倍。例如,在逻辑回归、K-means聚类等机器学习算法中,Spark的优势尤为明显。对于超大规模的一次性批处理作业,尤其是当内存不足以容纳所有中间数据时,Hadoop基于磁盘的稳健性可能更可靠。

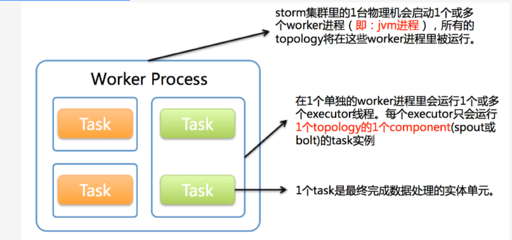

- 实时处理能力:Spark Streaming提供了近实时的微批处理能力,延迟可低至秒级,而Hadoop本身并非为实时处理设计,通常需要与其他工具(如Storm)结合。因此,在需要实时或准实时响应的场景,如果安奇云数据的数据流分析平台,Spark往往是更优选择。

- 资源管理与容错性:Hadoop YARN是一个成熟的集群资源管理器,能够高效地调度大规模作业。Spark可以独立运行,也可以运行在YARN之上,利用其资源管理能力。在容错方面,Hadoop通过数据多副本存储提供高容错性;Spark则通过RDD的血缘关系(Lineage)实现快速恢复,但内存数据的丢失可能带来重算开销。

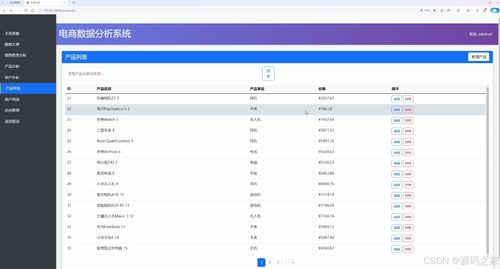

- 易用性与生态系统:Spark提供了Scala、Java、Python和R等多种语言的API,其高级模块如Spark SQL、MLlib、GraphX等,使得开发更为便捷。Hadoop生态系统更为庞大,包括Hive、HBase、Pig等成熟工具,适合构建复杂的数据仓库和处理流水线。火龙果软件工程在项目实践中,常根据具体需求混合使用两者生态中的工具。

三、适用场景与选型建议

- 选择Hadoop的情况:

- 数据量极大,且处理以一次性批处理为主。

- 预算有限,更需要利用廉价的磁盘存储而非昂贵的内存。

- 需要极高可靠性的长时间运行作业。

- 已有基于Hadoop生态的成熟体系,如使用Hive进行数据仓库查询。

- 选择Spark的情况:

- 需要低延迟的迭代计算,如机器学习和图分析。

- 实时或准实时流处理需求。

- 开发团队追求更简洁的API和更快的开发迭代速度。

- 内存资源相对充足,可以承担将数据缓存的开销。

四、融合使用趋势

在实际的大型数据平台中,Hadoop与Spark并非互斥。果安奇云数据在其云数据解决方案中,常见模式是使用HDFS作为底层可靠的数据存储层,利用YARN进行资源调度,而将Spark作为上层的高性能计算引擎。这种组合既能保证数据的安全性与持久性,又能满足多样化的高速计算需求。

Hadoop与Spark各有千秋。Hadoop像是一个稳重可靠的“重型卡车”,适合处理海量数据的批量搬运;而Spark则像是一辆“跑车”,在需要速度和灵活性的赛道上表现卓越。火龙果软件工程建议,技术选型应基于具体的业务需求、数据特性、团队技能和基础设施条件,综合考虑,必要时采用混合架构,以发挥各自的最大效能。

如若转载,请注明出处:http://www.gaqyl.com/product/20.html

更新时间:2026-04-22 08:57:07